Разделы блога

API распознавания речи CogniCo: транскрибация и транскрипция через REST API

Марфа Бердышева

Что такое API распознавания речи

API распознавания речи (Speech-to-Text API, или API транскрибации) – это программный интерфейс, через который ваше приложение отправляет аудиофайл и получает обратно готовый текст. Не нужно разрабатывать собственную модель, обучать нейросеть или разворачивать инфраструктуру: вы делаете HTTP-запрос и в ответ получаете транскрипцию.

Такой подход используют повсюду: колл-центры встраивают распознавание речи в CRM, HR-платформы автоматически расшифровывают интервью, образовательные сервисы генерируют субтитры к лекциям, разработчики голосовых ботов превращают аудио в команды. Общее у всех этих случаев одно: задача речевой транскрипции решается на стороне API, а бизнес-логика остаётся в вашем коде.

Качество распознавания во многом определяется моделью. В CogniCo для русского языка используется опенсорсная модель, заточенная под русскую речь, с нашей обёрткой поверх – она точнее справляется с разговорной речью, профессиональной лексикой и акцентами. Для других языков используется Whisper.

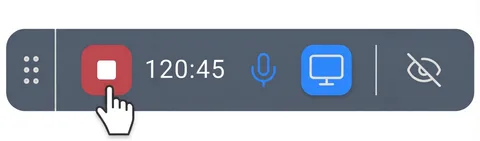

CogniCo – сервис для записи и расшифровки рабочих встреч: приложение записывает звонок прямо с компьютера, а модель распознавания превращает аудио в структурированный транскрипт с разделением по спикерам и AI-саммари. Теперь тот же движок доступен как API – чтобы разработчики могли встроить точную транскрибацию русской речи в свои продукты без необходимости строить инфраструктуру с нуля.

Как работает машинное распознавание речи

Современные методы распознавания речи основаны на глубоком обучении. Упрощённо процесс выглядит так:

- Предобработка аудио – нормализация громкости, шумоподавление, сегментация на речевые отрезки (VAD – Voice Activity Detection)

- Акустическая модель – нейросеть преобразует спектрограмму звука в последовательность фонем или токенов

- Языковая модель – контекстно восстанавливает слова, расставляет пунктуацию, исправляет омофоны

- Постобработка – диаризация (разделение по спикерам), временные метки, опциональная LLM-обработка

Технологии искусственного интеллекта для распознавания речи за последние годы сделали большой скачок. На чистом аудио точность достигает 90–97%. Ключевые факторы качества – качество записи, количество одновременно говорящих и насыщенность предметной лексикой.

API CogniCo: возможности

CogniCo Recognition API принимает аудиофайл и возвращает полную структурированную транскрипцию. Вот что входит в ответ:

Полный текст и сегменты

Поле text содержит весь распознанный текст одной строкой. Поле transcription.segments – массив речевых отрезков, каждый со своими атрибутами:

- Временные метки (

start,end) – точное время начала и конца сегмента в секундах - Точность на уровне слова – каждое слово внутри сегмента имеет свои

start,endиspeech_prob(вероятность того, что это действительно речь, а не шум) - Канал – если аудио многоканальное (например, отдельные дорожки участников созвона), каждый сегмент помечается каналом

Диаризация: разделение по спикерам

API автоматически определяет, кто говорит в каждом сегменте. Поле speaker в сегменте ссылается на идентификатор из массива transcription.speakers. Это даёт готовую разметку диалога без дополнительной обработки – особенно ценно для расшифровки совещаний, интервью и переговоров.

Анализ эмоций

Каждый сегмент содержит поле emotion с вероятностями по четырём классам: positive, angry, sad, neutral. Это открывает возможности для аналитики настроения в колл-центрах, оценки качества обслуживания и исследований пользовательского опыта.

VAD и речевые метрики

Поля vad_prob и speech_prob позволяют фильтровать нерелевантные сегменты на своей стороне: если вероятность речи низкая – это фоновый шум или пауза, а не потеря данных.

LLM-постобработка

Опциональный параметр ?pp=true включает постобработку текста большой языковой моделью. Это улучшает читаемость: корректирует пунктуацию в сложных случаях, восстанавливает аббревиатуры и специфическую терминологию.

Синхронный и асинхронный режимы

API предоставляет два эндпоинта с разной моделью работы.

Детальная спецификация доступна в документации API – там же можно скачать OpenAPI-файл для импорта в Postman. API-ключ создаётся в личном кабинете.

Синхронный режим (POST /api/v1/speech-to-text/sync) – запрос ждёт завершения распознавания и возвращает готовый результат напрямую. Удобен для коротких файлов и интерактивных сценариев, когда пользователь ждёт ответа в реальном времени.

Асинхронный режим (POST /api/v1/speech-to-text/async) – запрос сразу возвращает task_id с метаданными файла (имя, размер, длительность, формат). Результат забирается отдельным запросом GET /api/v1/speech-to-text/async/{task_id}. Этот режим подходит для длинных записей и пакетной обработки: не нужно держать соединение открытым, можно опрашивать статус задачи из фоновой очереди.

# Синхронный запрос

POST /api/v1/speech-to-text/sync?pp=true

Content-Type: multipart/form-data

Authorization: Bearer <api_key>

file=<audio_file>

# Асинхронный запрос

POST /api/v1/speech-to-text/async

→ { "task_id": "abc123", "duration_sec": 3600, "format": "mp3" ... }

GET /api/v1/speech-to-text/async/abc123

→ { "text": "...", "transcription": { ... } }

Формат ответа: транскрипция и метаданные

Полный пример ответа смотрите в документации API. Ниже – упрощённый фрагмент для понимания структуры:

{

"text": "Добрый день, давайте начнём встречу...",

"transcription": {

"segments": [

{

"start": 0.0,

"end": 3.4,

"text": "Добрый день, давайте начнём встречу.",

"speaker": "spk_0",

"emotion": { "positive": 0.72, "neutral": 0.21, "sad": 0.05, "angry": 0.02 },

"vad_prob": 0.98,

"speech_prob": 0.96,

"words": [

{ "word": "Добрый", "start": 0.0, "end": 0.4, "speech_prob": 0.99, "volume_avg": -18.2 },

{ "word": "день", "start": 0.5, "end": 0.9, "speech_prob": 0.99, "volume_avg": -17.8 }

]

}

],

"speakers": [

{ "id": "spk_0", "name": null, "ref": null }

]

},

"waiting_time": 0.3,

"recognition_time": 12.4,

"enhancement_time": 1.1

}

Поля waiting_time, recognition_time и enhancement_time показывают, сколько времени заняла каждая фаза обработки – полезно для мониторинга и оптимизации интеграции.

Сравнение с Яндекс SpeechKit

Яндекс SpeechKit – наиболее известный российский API распознавания речи. Сравним основные параметры:

| Параметр | CogniCo API | Яндекс SpeechKit |

|---|---|---|

| Цена за минуту | ~0.35 руб/мин | 0.61–0.65 руб/мин (в асинхронном режиме ~0.15 руб/мин) |

| Диаризация (разделение спикеров) | Да, в ответе | Отдельный тариф |

| Анализ эмоций | Да | Нет |

| LLM-постобработка | Да | Нет |

| Синхронный режим | Да | Да |

| Асинхронный режим | Да | Да |

Яндекс SpeechKit тарифицирует по 15-секундным отрезкам, минимальная единица – 15 сек. Подробнее на странице тарифов.

Яндекс SpeechKit хорошо подходит для задач с высокой нагрузкой и сложными требованиями к SLA. CogniCo API выигрывает там, где нужна богатая структура ответа из коробки: готовая диаризация, эмоциональная аналитика и LLM-улучшение без дополнительных вызовов и интеграций – и при этом дешевле.

Кому подходит API транскрибации

Колл-центры и клиентский сервис. Автоматическая расшифровка звонков с разделением по каналам (оператор / клиент), анализ тональности разговора, контроль качества обслуживания по эмоциям в каждом сегменте.

HR и рекрутинг. Транскрипция интервью и структурирование ответов кандидатов. Вместо того чтобы прослушивать запись повторно, рекрутер работает с текстом, отсортированным по спикерам.

EdTech и онлайн-образование. Автоматические субтитры и текстовые конспекты лекций. Возможность поиска по тексту внутри видеоматериала.

CRM и продажи. Встраивание расшифровки звонков прямо в карточку сделки, поиск по ключевым словам и автоматическое заполнение полей.

Исследования и аналитика. Обработка больших массивов аудиоданных: глубинные интервью, фокус-группы, пользовательские тестирования – всё это превращается в структурированный текст для дальнейшего анализа.

Голосовые ассистенты и боты. Компонент распознавания речи с помощью API легко встраивается в пайплайн голосового бота: аудио → текст → обработка NLP → ответ.

Как начать работу

- Перейдите в личный кабинет CogniCo и создайте API-ключ

- Изучите документацию API – там же можно скачать OpenAPI-спецификацию, импортировать её в Postman или сгенерировать клиент для вашего языка

- Сделайте первый запрос – загрузите любой аудиофайл и убедитесь, что формат ответа подходит для вашей задачи

API можно протестировать бесплатно – достаточно, чтобы оценить качество распознавания на реальных данных и принять решение об интеграции.

Документация API и примеры запросов – на странице документации. API-ключ создаётся в личном кабинете. Первый запрос – за несколько минут.

CogniCo

Запись и расшифровка встреч через приложение CogniRec

- ✓Без бота в конференции

- ✓Бесшовная запись в 1 клик

- ✓Транскрипт и саммари сразу